A/B-Tests sind in aller Munde. Konversionsoptimierung ist meist billiger als neue Marketing-Maßnahmen, d.h., der Hebel bei dem gleichen monetären Aufwand sowie Ressourceneinsatz ist einfach größer. Zumindest wird das von vielen Online-Marketing-Experten behauptet. Ich habe in den letzten Jahren viel zu dem Thema gelesen und die Argumente sind einleuchtend. Und trotzdem …unser Hauptprojekt hat doch schon gute Konversionsraten. Unsere Seite sieht auch viel besser aus als die der Konkurrenten. Was soll da schon groß durch weitere Tests rauszuholen sein?

Ich fand das Thema A/B-Tests schon immer interessant, aber ich habe mich nie wirklich herangetraut. Warum eigentlich? Im Nachhinein betrachtet ist das schwierig zu beantworten. Im Februar las ich einen Artikel über eine Berliner Agentur auf seo-united.de, die zu moderaten Festpreisen A/B-Tests anbietet. Unterstützung von Experten und überschaubares Risiko, dachte ich. Außerdem brannte ich zu diesem Zeitpunkt darauf, eine Sache auszuprobieren.

Tipp 1: Input liefern!

Nach wenigen aber intensiven Gesprächen, in denen ich sehr deutlich auf unsere Problematiken hinwies, buchten wir direkt zwei A/B-Tests und erhielten nach wenigen Tagen einen plausiblen Vorschlag zur Erhöhung der über unsere Website generierten Anfragen. Verändert wurde der Header. Wir legten mehr Fokus auf Kommerzialität und brachten des Weiteren unsere USPs prominent unter. Der Test wurde gestartet und wir waren sehr gespannt auf die ersten Ergebnisse. Und nun schon zum ersten Tipp: Macht euch Gedanken, schildert eure Probleme und arbeitet mit der Agentur!

Nach 3700 Besuchern erhielt ich einen Anruf des zuständigen Mitarbeiters: „Herr Gerth, wir können es nicht glauben. Das ist das erste Mal, dass die getestete Variante schlechter abschneidet als die Basis“.

Klasse!!! Geld verlieren und oben drauf noch die Agentur für dieses Dilemma bezahlen! Das war zu diesem Zeitpunkt die Erkenntnis. Doch damit wollten wir uns nicht zufriedengeben.

Tipp 2: Analysieren!

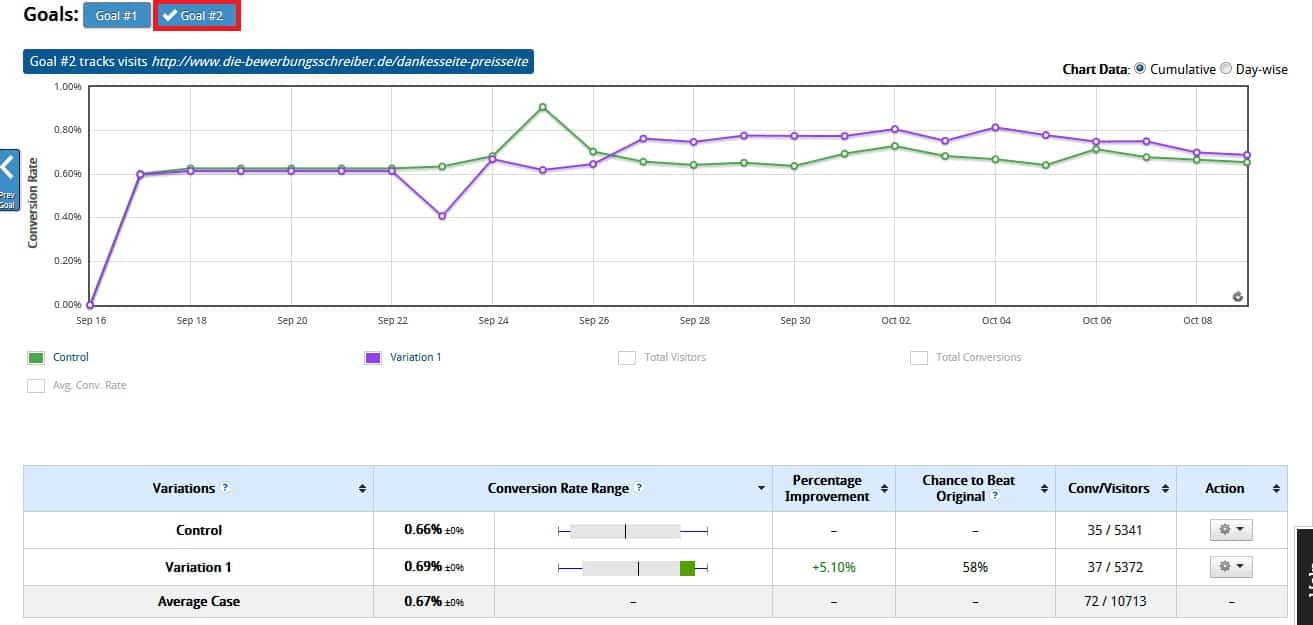

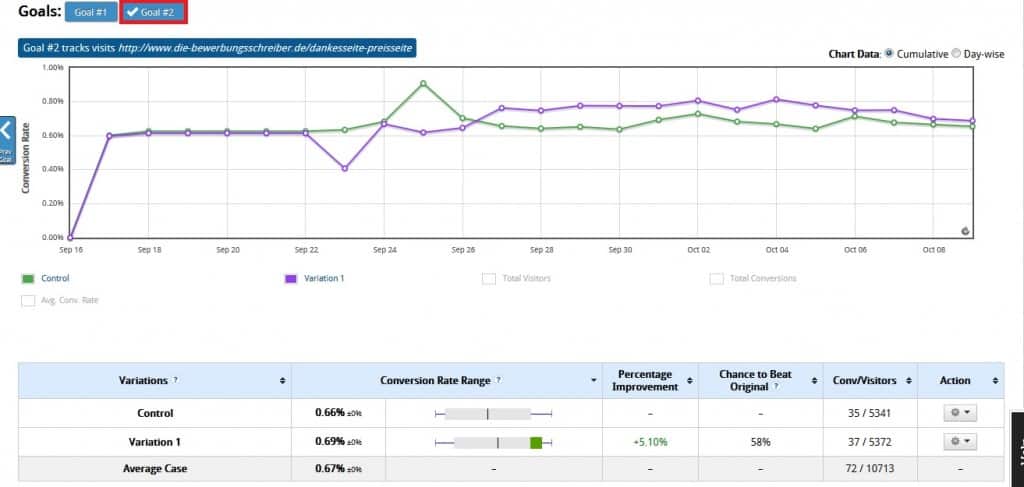

In unserem Fall ist es wichtig, folgende Hintergrundinformationen zu haben. Bis dato sammelten wir unsere Leads über 4 Seiten: Kontaktformular, Preisseite und zwei weitere Seiten mit Minikontaktformularen. Letztere Leads bezeichnen wir intern als „Schrottleads“, da viele User es nur in der Hoffnung etwas kostenlos zu bekommen ausgefüllt haben. Im eingerichteten Test wurden jedoch alle Leads gleichwertig behandelt (es wurde nur ein Ziel eingerichtet und getrackt). Unsere Vermutung war, dass durch die offensichtlich gestiegene Kommerzialität unsere sogenannten „Schrottleads“ abnahmen, die hochwertigen Leads jedoch stiegen. Wir setzten den Test neu auf und richteten nun vier Ziele ein. Die Agentur stellte uns kulanterweise einen Link zu dem genutzten Tool Visualwebsiteoptimizer zur Verfügung. So konnten wir die Ergebnisse live verfolgen. Wir stoppten den Test nach 12.430 Besuchern.

Ergebnisse: Wir konnten eine Verbesserung bei allen vier Zielen verzeichnen. Insgesamt hatten wir einen Uplift von:

30,49%

Betrachtet man nur die für uns interessanten qualitativ hochwertigen Leads war der Uplift sogar noch größer:

36,17%

Dass sogar unsere sog. „Schrottleads“ besser performten führe ich darauf zurück, dass sich der Traffic auf diese Seiten aufgrund von Rankingschwankungen etwas verändert hat.

Tipp 3: Seid geduldig!

Was ich rückwirkend ebenfalls eingestehen muss, war die Tatsache, dass der Testzeitraum beim ersten Versuch evtl. zu kurz war. Deshalb rate ich dazu Durchhaltevermögen an den Tag zu legen und ausreichend Besucher und Konversionen zuzulassen, um vailde Ergebnisse erzielen zu können.

Tipp 4: Testet auch eure Tools

Wir führten auch noch einen dritten Test mit der Agentur durch, der ebenfalls positiv verlief. Hierbei wurde das Tool Optimizely genutzt. Dazu werde ich mich an anderer Stelle nochmal äußern.

Nach meinen ersten Erfahrungen in Zusammenarbeit mit der Agentur war ich nun voller Begeisterung und entschied mich das Thema selbst in die Hand zu nehmen. Es gab immer mehr Ideen zu möglichen Tests. Zunächst musste jedoch das passende Tool ausgewählt werden. Von der Handhabung her sind beide genannten Tools fantastisch, Test sind schnell und sehr einfach einzurichten, auch ohne jegliche html-Kenntnisse. Optimizely bietet eine 30-tägige-Testversion an. Danach liegen die Kosten bei 59 $ für 20.000 Besucher monatlich. Der Visualwebsiteoptimizer ist für 1000 Besucher monatlich kostenlos zu haben, was aber viel zu wenig ist. Danach kosten 10.000 Besucher 49 $ monatlich. Die Annahme, das 10.000 Besucher locker ausreichen würden, war nach 14 Tagen dann auch hinfällig. Insofern empfehle ich aufgrund des Preises Optimizely. Werden Änderungen getestet, die nicht nur eine einzige Unterseite des eigenen Projekts betreffen, z.B. eine Änderung in der Sidebar (Änderung ist in unserem Fall auf fast allen Seiten sichtbar), muss man ohnehin das wesentlich teurere Gold-Paket von Optimizely buchen. Mit dem Visualwebsiteoptimizer sind solche Tests gar nicht erst möglich.

Unsere Videotests

Was wollten wir nun selbst testen? Durch einen Artikel auf deutsche-startups.de bin ich Anfang Juni auf das Projekt Clipvilla von Jens Neumann gestoßen. Mit Clipvilla ist es möglich sehr günstig 30 bzw. 60 sekündige Videos zu produzieren. Es gibt zahlreiche vorgefertigte Templates, die vor allem als Unternehmensvideos genutzt werden können. Das hörte sich spannend an! Jetzt gilt es an dieser Stelle zu wissen, dass wir immer wieder Anrufe von Kunden bekamen, die nicht so recht wussten wie der Ablauf bei uns ist. Dass wir diesem Informationsbedarf auf unserer Website Abhilfe schaffen mussten, war uns schon lange klar. Nun schien die Lösung so nah. Wir investierten wirklich eine Menge Zeit in die Produktion des ersten Videos (ohne Sprecher). Templates beinhalten natürlich einige Einschränkungen, auch was die Verwendung von Texten angeht. Deshalb diskutierten wir lange und Intensiv über Sätze, eigens produzierte Grafiken und auch die Auswahl der Musik.

Tipp 5: Analysiert die Ergebnisse!

Nach Fertigstellung folgte nun der erste eigens eingerichtete A/B-Test. Wir testeten das Video auf der Startseite gegen die Ausgangsbasis, ein Foto, an gleicher Stelle. Nach 3 Tagen lag die Basis deutlich mit rund 100% vorne, was mich dazu bewog mir den Test nochmal genau anzuschauen. Ich bemerkte, dass ich den Test falsch eingerichtet hatte. Im Grunde testeten wir die Startseite gegen die Startseite ohne Änderung. Warum dann so ein Ergebnis? Ich kann es mir nicht gänzlich erklären. Auch hierbei war der Testzeitraum nur sehr kurz und der Zufall hat mit Sicherheit eine gewichtige Rolle gespielt. Trotzdem vermute ich, dass die Ladezeiten der getesteten Variante doch etwas länger sind. Insofern müsste man der Basis bei allen Tests einen kleinen Vorsprung zuschreiben.

Zweiter Versuch! Ich testete diesmal auch den Test bevor ich ihn live schaltete… Jetzt war er wie gewünscht eingerichtet. Nach 4 Tagen lag wieder die Basis, wenn auch nur sehr knapp, vorn. Ich änderte jedoch nochmal einen Parameter, weil die Anzahl der getrackten Besucher nicht unserem tatsächlichem Traffic entsprach. Von nun an war jeder Besucher unserer Domain vom Test eingeschlossen. Bis dato wurden nur Besucher getrackt, die die Startseite als Einstiegsseite genutzt hatten. Unter diesen Voraussetzungen gewann das Video nach 130 getrackten Konversionen deutlich. Der Uplift betrug:

20,34%

Ehrlich gesagt hatte ich mir von dem Video einen noch größeren Effekt erwartet. Jetzt gilt es jedoch zwei Dinge zu wissen: Zum Einen fordert das Video dazu auf direkt eine E-Mail zu schreiben (Anfragen per E-Mail wurden nicht getrackt), zum Anderen wird nicht jede Anfrage zum Kunden. Ab Juli konnten wir eine deutliche Verbesserung dieser Rate feststellen. Mit Sicherheit spielen an dieser Stelle auch andere Einflussfaktoren eine Rolle, das Video wird jedoch auch seinen Beitrag geleistet haben. In der Zwischenzeit produzierten wir bereits eine zweite Variante des Videos mit Sprecher. Das Video wirkt insgesamt seriöser und informativer. Der Test Ursprungsvideo gegen neues Video lief 21 Tage und brachte nochmal einen Uplift von

9,52%

Seit Mai laufen durchgehend unterschiedliche A/B-Tests auf unserer Webseite. Allein diese Tatsache beweist, wie vehement wichtig das Thema für uns geworden ist. Wir haben kürzlich einen Test beendet, dessen Änderung uns monatlich einen ordentlichen Betrag an Umsatz zusätzlich generiert. Was haben wir getestet? Wir haben ein einziges Wort in der Hauptnavigation ersetzt. Diese Erkenntnis allein verdeutlicht, wie wichtig das Thema Testing ist. Vertraut niemals Euch selbst oder euren Vermutungen. Testet es!

1 Gedanke zu „Über die Sinnhaftigkeit von A/B-Tests und meine Erfahrungswerte“

Die Kommentare sind geschlossen.